per Manel Soengas

La Llei d’intel·ligència artificial (IA) de la Unió Europea (AI Act) estableix un marc normatiu per regular l’ús de la IA a Europa. Aquesta legislació classifica els sistemes d’IA segons el seu nivell de risc i estableix restriccions específiques per protegir els drets fonamentals, la seguretat i la privacitat. En l’àmbit educatiu, existeixen plataformes que utilitzen IA per personalitzar l’aprenentatge, correcció automatitzada d’exàmens i eines de gestió acadèmica. L’objectiu d’aquest article és analitzar com aquesta regulació afecta l’educació i quins usos de la IA es permetran, estaran restringits o seran prohibits.

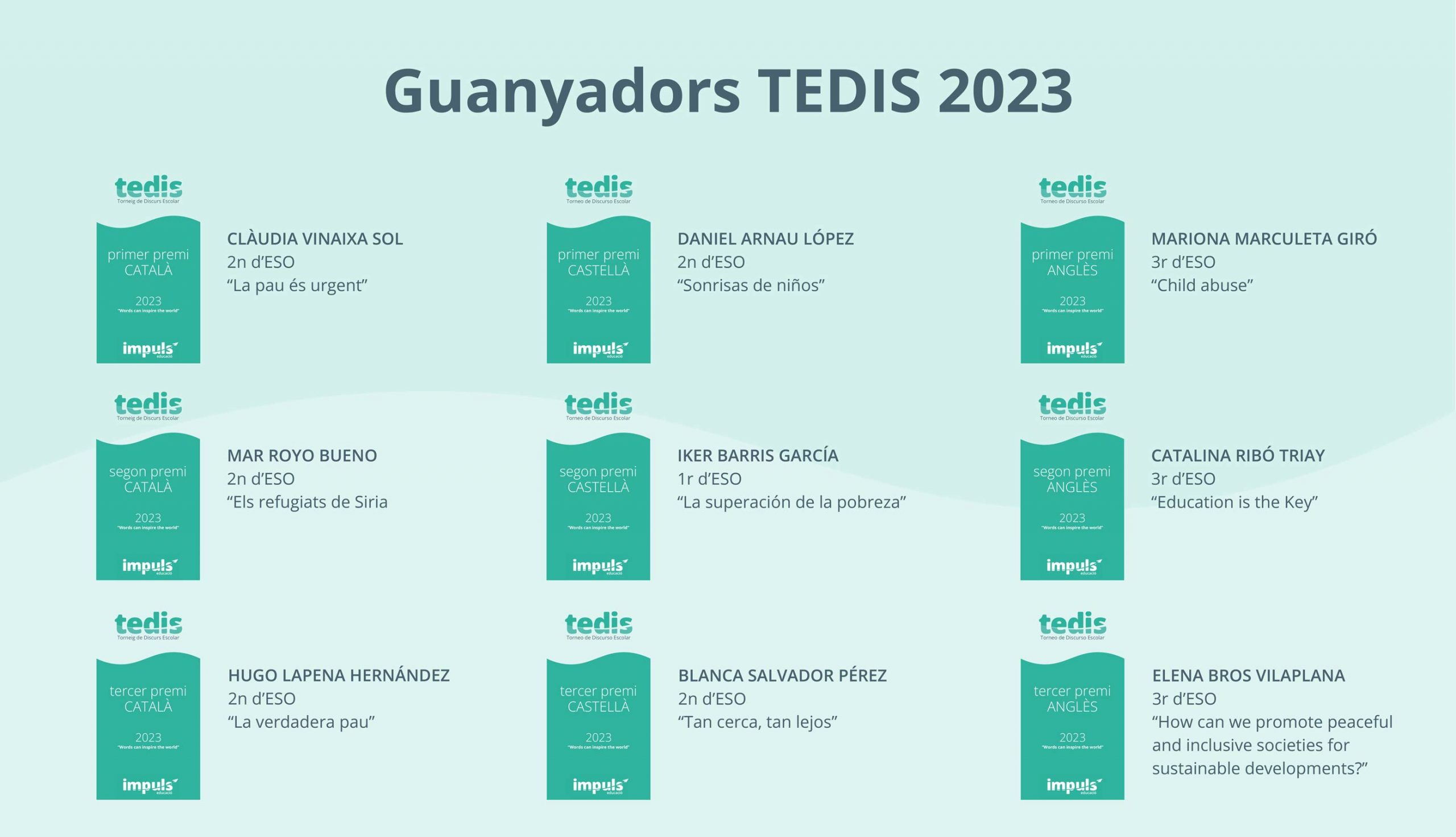

Figura 1. Imatge generada amb intel·ligència artificial generativa.

La Llei d’IA de la UE: Una visió general

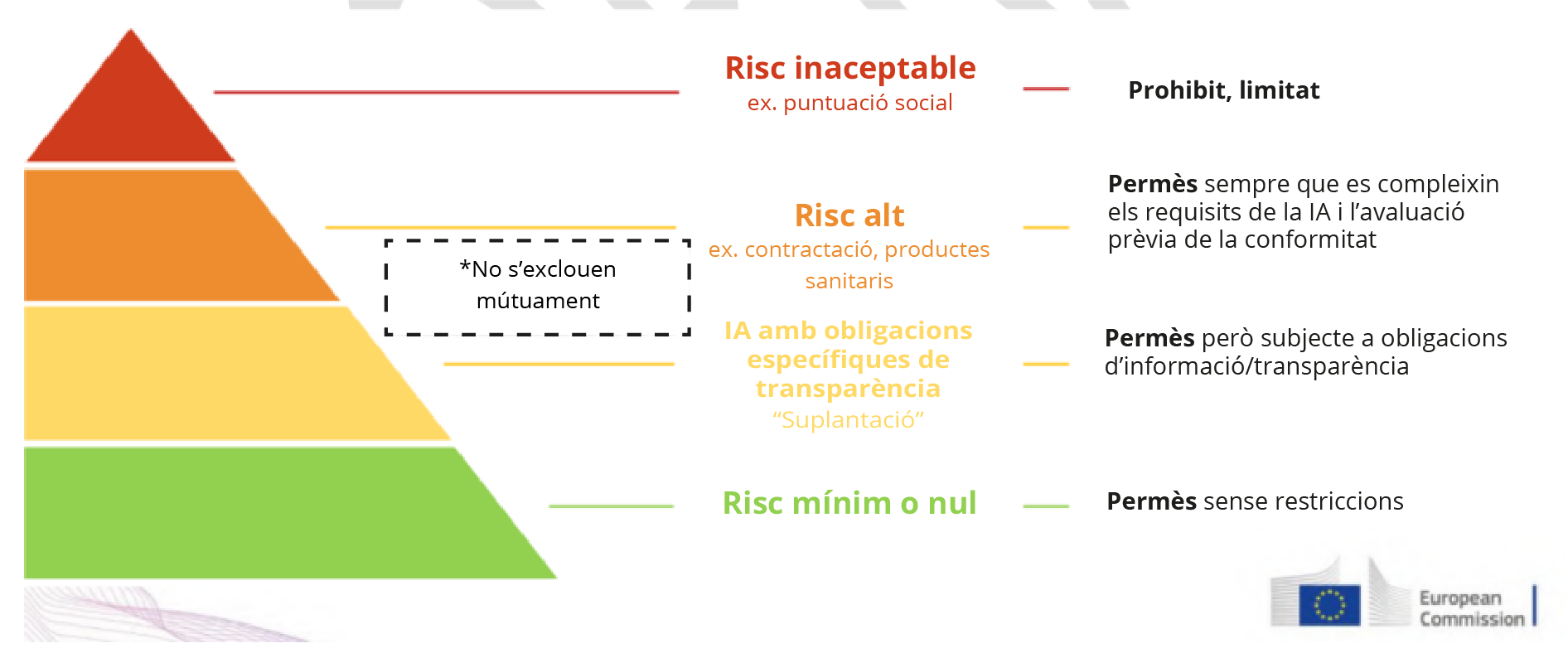

La Llei d’IA europea classifica les aplicacions d’IA en quatre categories de risc:

- Risc inacceptable: sistemes prohibits per considerar-se una amenaça per als drets fonamentals.

- Risc alt: aplicacions que poden afectar la seguretat o els drets de les persones i que requeriran avaluacions estrictes.

- Risc limitat: sistemes amb requisits de transparència per garantir un ús adequat.

- Risc mínim: aplicacions que no suposen un perill significatiu i que es poden utilitzar lliurement.

La Llei d’IA classifica les aplicacions en quatre nivells de risc: inacceptable, alt, limitat i mínim

La IA en l’educació: On s’està aplicant?

Actualment, la IA s’està utilitzant en diversos àmbits de l’educació, mitjançant plataformes i l’ús dels models del llenguatge:

- Aprenentatge personalitzat: eines com Khan Academy amb IA ajusten el contingut a les necessitats de l’estudiant.

- Avaluació automatitzada: sistemes que corregeixen exàmens de tipus test o, fins i tot, redaccions.

- Tutors virtuals: assistents d’IA que ajuden els estudiants amb dubtes sobre diferents matèries.

- Plataformes de gestió acadèmica: IA aplicada a la detecció de l’abandonament escolar o millora en la planificació de recursos.

- Ús d’intel·ligència artificial generativa per a la creació d’activitats d’aprenentatge mitjançant models de llenguatge (LLM).

A partir d’aquest escenari es donen diferents tipus d’utilització, segons el perfil de l’àmbit:

- Administració: Tot i no desplegar sistemes d’IA, ha elaborat orientacions adreçades als centres educatius en matèria d’“Orientacions i recomanacions per a l’ús de la intel·ligència artificial als centres educatius” (AI Act). També organitza cursos de formació pel professorat així com el recull i difusió de bones pràctiques i recursos a través d’una web corporativa.

- Centres educatius: Es combina l’ús de plataformes i models de llenguatge per dur a terme tasques administratives i de gestió, com ara la confecció d’horaris, la gestió de l’assistència o la creació de plantilles de documents, entre d’altres.

- Docents: Utilitzen eines basades en models d’IA per preparar material didàctic, gestió de tasques administratives o la personalització de l’aprenentatge, entre altres.

- Alumnat: Fan servir la IA generativa, principalment, per generar contingut, suport a l’estudi o practicar idiomes, per citar alguns exemples.

Riscos i regulació de la IA en educació segons la Llei

L’ús creixent de la intel·ligència artificial en educació ofereix grans oportunitats, però també reptes que requereixen una regulació clara. Sense un marc normatiu adequat, l’ús d’IA en l’avaluació, la personalització de l’aprenentatge o la gestió de dades pot generar biaixos, vulnerar la privacitat de l’alumnat i comprometre l’equitat o transparència en els processos educatius o d’aprenentatge. A més, és essencial garantir que aquestes tecnologies complementin la tasca docent sense substituir-ne el rol pedagògic. Per això, una regulació específica en l’àmbit educatiu és important per assegurar un ús ètic, responsable, segur i equitatiu de la IA en l’àmbit educatiu. La Llei d’IA estableix que algunes aplicacions poden considerar-se d’alt risc, mentre que d’altres seran acceptables amb condicions específiques:

Docents i alumnes ja fan servir la IA per crear continguts, però cal tenir en compte els límits legals i ètics d’aquests usos

- Aplicacions prohibides (risc inacceptable): La comercialització, la posada en servei per a aquesta finalitat específica o l’ús de sistemes d’IA per inferir emocions d’una persona física en els àmbits del lloc de treball i de les institucions educatives, excepte quan l’ús del sistema d’IA estigui destinat a ser posat en funcionament o al mercat per raons mèdiques o de seguretat.

- Aplicacions d’alt risc (requereixen avaluació prèvia): Educació i formació professional:

- Sistemes d’IA destinats a ser utilitzats per determinar l’accés o l’admissió o assignar persones físiques a institucions educatives i de formació professional de tots els nivells.

- Sistemes d’IA destinats a ser usats per avaluar els resultats de l’aprenentatge, fins i tot, quan aquests resultats es fan servir per dirigir el procés d’aprenentatge de les persones físiques a centres educatius i de formació professional de tots els nivells.

- Sistemes d’IA destinats a ser utilitzats per avaluar el nivell adequat d’educació que un individu rebrà o al qual podrà accedir, en el context d’institucions educatives i de formació professional a tots els nivells.

- Sistemes d’IA destinats a ser utilitzats per controlar i detectar comportaments prohibits dels estudiants durant les proves en el context de les institucions educatives i de formació professional a tots els nivells o dins d’aquestes.

- Aplicacions de risc mínim: La normativa sobre IA no estableix requisits específics per als sistemes considerats de risc mínim o inexistent. La major part de les aplicacions d’IA en ús actualment a la UE pertanyen a aquesta categoria, com ara els videojocs amb funcionalitats d’intel·ligència artificial o els filtres automàtics per detectar correu no desitjat.

Aquests sistemes estan subjectes a obligacions estrictes per garantir la seva seguretat i fiabilitat. Alguns dels requisits que han de complir són els següents: avaluació de la conformitat, gestió de riscos, qualitat de les dades, documentació tècnica, transparència i informació a l’usuari, supervisió humana i ciberseguretat.

Figura 2. Reglament Europeu d’IA.

L’AI Act es va aprovar el 2024 i seguirà una implantació progressiva en els pròxims anys. Segons el calendari previst, l’any 2027 s’aplicarà a tots els actors participants.

Implicacions per a docents i institucions educatives

El marc legal establert pel Parlament Europeu obliga els governs a implementar la llei de manera gradual. Però, fins que la seva aplicació sigui completa, és necessari tenir en compte alguns escenaris:

- L’ús d’un LLM està subjecte a limitacions d’edat, la qual cosa implica de manera directa a l’alumnat. En alguns casos pot ser necessària l’autorització dels pares o tutors legals.

- Aplicacions o plataformes basades en l’ús de LLM, com ara ChatGPT, és recomanable no utilitzar-les com a eines d’avaluació. No hi ha cap avaluació prèvia que acrediti, validi i autoritzi aquest ús. Aquest fet no significa que els LLM no puguin tenir cap ús educatiu. Es poden emprar com eines de suport.

- En el cas d’eines o recursos basats en IA, cal verificar on s’emmagatzemen les dades, si se cedeixen a tercers, qui hi té accés i si les dades o converses s’utilitzen per entrenar i millorar el model.

Els centres educatius hauran de revisar la seguretat de dades i l’edat mínima abans d’introduir eines basades en IA generativa

Tot i que el Reglament General de Protecció de Dades (RGPD) ja estableix normes estrictes, la Llei d’Intel·ligència Artificial (AI Act) encara no s’aplica completament. Aquest buit legal obliga a estar alerta, vetllar i comprovar que les eines o recursos basats en IA compleixen els estàndards exigits pel RGPD i s’adapten a les futures regulacions de l’AI Act.

Per als usuaris i centres educatius, aquests aspectes sovint passen desapercebuts per la seva complexitat legal, fet que pot suposar riscos en la protecció de dades i la privacitat. A partir d’aquest escenari es recomana abans de fer servir un model d’IA generativa (LLM) o contractar un servei basat en IA, les següents accions:

- Revisar les polítiques de privacitat per comprovar si les dades s’utilitzen per entrenar el model o si es comparteixen amb tercers.

- Prioritzar eines d’IA que compleixin el RGPD i que ofereixin garanties sobre el tractament de dades.

- Consultar si el proveïdor està subjecte a les regulacions de la UE i si adopta mesures per anticipar-se a l’AI Act.

- Evitar serveis que no siguin transparents sobre l’ús i emmagatzematge de dades, especialment en entorns educatius.

- Si es tracta d’un servei per a menors d’edat, assegurar-se que compleix amb la normativa de protecció de dades per a menors i que no requereix informació personal innecessària.

Conclusions i perspectives de futur

La Llei d’IA europea marcarà un abans i un després en l’ús de la IA en educació. Tot i que algunes aplicacions seran restringides per protegir els drets dels estudiants, moltes altres podran transformar positivament l’aprenentatge. Els docents i institucions hauran d’adaptar-se a aquest nou marc legal per garantir un ús ètic i responsable de la IA. La formació en IA i regulació serà clau per aprofitar el seu potencial sense posar en risc els principis fonamentals de l’educació.

Manel Soengas és docent de tecnologia, enginyer industrial i màster en IA. Actualment, treballa com a gestor tecnològic a l’àrea TIC del Departament d’Educació, combinant-ho amb tasques de formació en cultura digital, divulgació, comunicació i assessorament en relació amb la intel·ligència artificial.