por Impuls Educació

La inteligencia artificial (IA) se está posicionando en un lugar central en múltiples aspectos de la vida contemporánea. Su impacto en la educación empieza a ser cada vez más notorio, generando profundos debates académicos, educativos y filosóficos. En su reciente conferencia “Inteligencia humana e inteligencia artificial”, durante el EdTech Congres, Barcelona 2024, Daniel Innerarity, filósofo y profesor de investigación en filosofía política, reflexiona sobre las diferencias y similitudes entre la inteligencia humana y la artificial, y cómo estas dos pueden coexistir en lugar de competir.

Para los docentes, entender este panorama es crucial. La IA está redefiniendo el papel del maestro y los métodos de enseñanza, pero no sin presentar desafíos éticos y pedagógicos. Innerarity argumenta que no se trata de una competición entre la inteligencia humana y la artificial, sino de cómo ambas pueden complementarse para mejorar los procesos educativos y potenciar las capacidades humanas.

Inteligencia humana e IA pueden complementarse para mejorar y potenciar las capacidades humanas

Este artículo busca analizar las ideas presentadas por Innerarity en su conferencia y ofrecer una reflexión sobre cómo los docentes pueden integrar estas ideas en sus prácticas, enfrentando los retos y aprovechando las oportunidades que brinda la IA en el ámbito educativo. Tras la disertación filosófica del autor y desde sus propuestas, se analiza un caso real en que ambas inteligencias se enfrentan en un duelo mítico.

Inteligencia Artificial vs. Inteligencia Humana

Para comenzar, Daniel Innerarity define las diferencias entre la inteligencia artificial y la inteligencia humana.

La inteligencia artificial es una forma de inteligencia basada en algoritmos, capaces de procesar grandes cantidades de datos, reconocer patrones y aprender de ellos, gracias a técnicas como el “machine learning”. Es esencialmente una inteligencia instrumental, diseñada para resolver problemas específicos de manera eficiente.

La inteligencia artificial es instrumental y está diseñada para resolver problemas específicos de manera eficiente

En contraste, la inteligencia humana es mucho más flexible y contextual. Innerarity subraya que la inteligencia humana no se basa solo en el procesamiento de información, sino en la capacidad de interpretar y dar sentido a los datos en un contexto determinado. Los seres humanos no solo piensan y resuelven problemas, sino que también sienten, comprenden y aplican un juicio moral.

La inteligencia humana se basa en la capacidad de interpretar y dar sentido a los datos en un contexto determinado

Según Innerarity, la inteligencia humana es creativa y adaptable, algo que la IA todavía no puede replicar. Un aspecto clave que distingue ambas inteligencias es que la IA está limitada por su programación, mientras que la inteligencia humana es capaz de improvisar, adaptarse a situaciones nuevas y tomar decisiones basadas en valores y emociones.

Innerarity no considera estas diferencias como una desventaja para la IA ni como una amenaza para la inteligencia humana. En cambio, ve una oportunidad para que ambas colaboren y se complementen, combinando la capacidad de procesamiento y eficiencia de la IA con la creatividad y juicio crítico humanos.

La complementariedad entre IA e Inteligencia Humana

Uno de los puntos clave de la conferencia de Innerarity es que la inteligencia artificial y la humana no deben verse como competidoras, sino como aliadas que pueden potenciarse mutuamente. En lugar de temer que la IA sustituya a los humanos en actividades intelectuales, Innerarity sugiere que deberíamos pensar en cómo la IA puede complementar y amplificar nuestras capacidades cognitivas.

En el ámbito educativo, esta complementariedad ya se está manifestando de varias formas. Los algoritmos de IA pueden ayudar a los docentes a identificar patrones de aprendizaje en los estudiantes, y a personalizar los enfoques pedagógicos para adaptarse a las necesidades específicas de cada alumno. Además, la IA puede realizar tareas repetitivas y administrativas, como la calificación de pruebas o la gestión de datos, lo que libera tiempo para que los docentes se concentren en tareas que requieren empatía, creatividad y juicio.

Innerarity plantea que, mientras la IA puede ser una herramienta extremadamente útil, los seres humanos deben seguir manteniendo el control sobre las decisiones más importantes. En la educación, los docentes deberían usar la IA para mejorar la experiencia educativa, pero sin delegar completamente la responsabilidad de enseñar a las máquinas.

Los docentes deben usar la IA para mejorar la experiencia educativa sin delegar en ella del todo la responsabilidad de enseñar

Un ejemplo claro de esta complementariedad se encuentra en el uso de plataformas educativas basadas en IA que permiten a los docentes monitorear el progreso de los estudiantes de manera más efectiva, mientras que estos siguen desempeñando un papel crucial en la guía emocional y el desarrollo crítico de los alumnos.

Desafíos éticos y pedagógicos

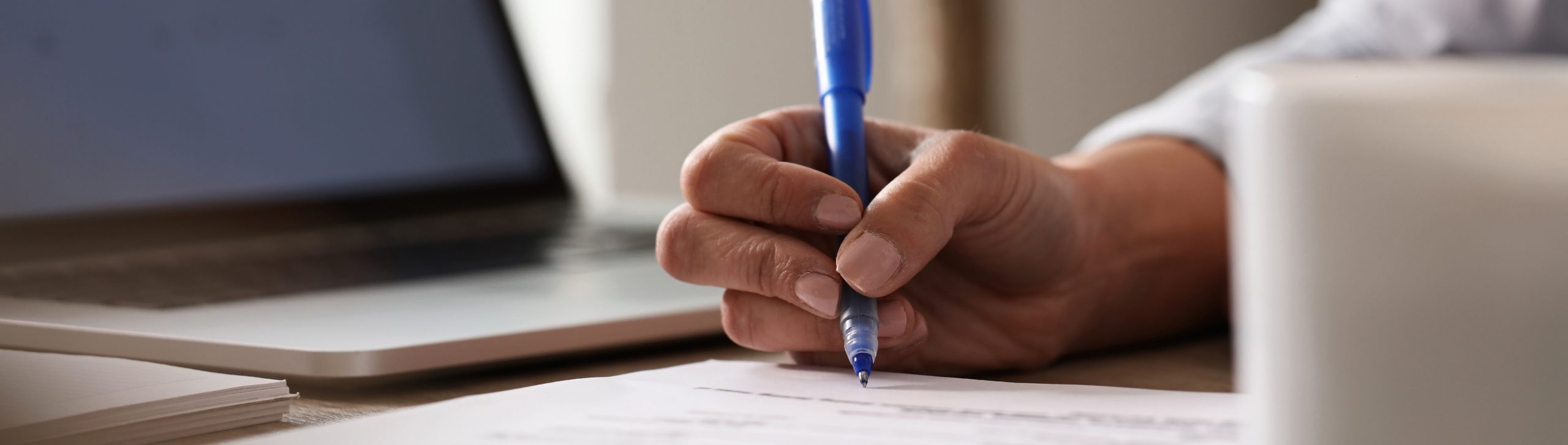

A lo largo de su disertación, Innerarity plantea varias cuestiones éticas sobre la relación entre la inteligencia humana y la artificial, que son especialmente relevantes en el campo de la educación. Uno de los principales desafíos que aborda es la posible pérdida de autonomía del docente frente a la creciente dependencia de la IA en las aulas.

Por ejemplo, ¿cómo se debe hacer frente a la creciente automatización de ciertos aspectos de la enseñanza? Innerarity advierte que, aunque la IA puede ayudar a los docentes a ser más eficientes, existe el riesgo de que estos pierdan control sobre ciertas decisiones pedagógicas importantes. En este sentido, es vital que los educadores mantengan una visión crítica y reflexiva sobre el uso de la tecnología en las aulas, asegurándose de que la IA no sustituya su capacidad para tomar decisiones complejas y éticamente fundamentadas.

Otro de los desafíos éticos que plantea Innerarity es el sesgo inherente en los algoritmos de IA. Los sistemas de IA son desarrollados y entrenados en base a datos históricos que, en muchos casos, pueden reflejar prejuicios sociales preexistentes. En el ámbito educativo, esto puede traducirse en la perpetuación de desigualdades o en decisiones basadas en criterios que no tienen en cuenta las complejidades del individuo. Los docentes tienen la responsabilidad de supervisar el uso de IA para asegurarse de que los algoritmos no generen sesgos que puedan afectar negativamente a los estudiantes.

Los sistemas de IA están basados en datos históricos que pueden reflejar prejuicios sociales preexistentes

Finalmente, Innerarity destaca la importancia del juicio moral, algo que es exclusivo de los seres humanos. Si bien la IA puede procesar grandes volúmenes de información y hacer recomendaciones, solo los seres humanos pueden tomar decisiones basadas en principios éticos. En este sentido, los docentes tienen un papel clave en asegurar que la enseñanza no se limite a la transmisión de conocimiento, sino que también incluya la formación ética y emocional de los estudiantes.

Los docentes tienen que asegurar que la enseñanza incluya la formación ética y emocional de los estudiantes

Hacia una Inteligencia Híbrida

Innerarity propone el concepto de “inteligencia híbrida”, una combinación de las mejores cualidades de la inteligencia humana y la artificial. Esta inteligencia híbrida no busca sustituir ninguna de las dos, sino crear un sistema en el que ambas colaboren para generar mejores resultados.

En el campo educativo, esta inteligencia híbrida se manifiesta cuando los docentes utilizan la tecnología para mejorar sus propias habilidades y conocimientos. La IA puede ofrecer datos y análisis precisos, mientras que los docentes interpretan esos datos desde una perspectiva humana, teniendo en cuenta las emociones, las experiencias y los valores de sus estudiantes. Este enfoque combina la eficiencia técnica con la empatía y el juicio ético, creando un entorno educativo más completo y adaptado a las necesidades del siglo XXI.

Innerarity plantea que la inteligencia aumentada no debe ser vista como una amenaza, sino como una oportunidad para que los docentes amplíen sus capacidades, permitiendo un enfoque más personalizado y efectivo en el aula.

La inteligencia híbrida combina la eficiencia técnica con la empatía y la ético, creando un entorno educativo más completo

Innerarity plantea que la inteligencia artificial no debe ser vista como una amenaza, sino como una oportunidad para que los docentes amplíen sus capacidades, permitiendo un enfoque más personalizado y efectivo en el aula.

Conclusión

La conferencia de Daniel Innerarity nos invita a reflexionar sobre el futuro de la inteligencia humana en un mundo donde la inteligencia artificial está cada vez más presente. Para los docentes, este es un tema crucial, ya que la IA está transformando la educación de forma profunda.

Sin embargo, tal como señala Innerarity, la inteligencia humana sigue siendo insustituible en áreas clave como el juicio moral, la creatividad y la empatía. Los docentes no deben temer a la IA, sino aprender a usarla como una herramienta que puede mejorar sus habilidades y hacer que la enseñanza sea más eficiente y personalizada.

El desafío principal para los educadores es encontrar el equilibrio entre la automatización y la humanidad en el proceso educativo. La clave está en abrazar la tecnología sin perder de vista los valores fundamentales que hacen de la enseñanza una labor esencialmente humana. Como docentes, la misión es formar no solo estudiantes competentes, sino también personas éticas y críticas, capaces de enfrentar los retos de un mundo cada vez más tecnológicamente avanzado.

El desafío para los educadores es encontrar el equilibrio entre la automatización y la humanidad en el proceso educativo

Te aconsejamos escuchar la conferencia completa:

Comparación de ambas inteligencias. Un ejemplo real

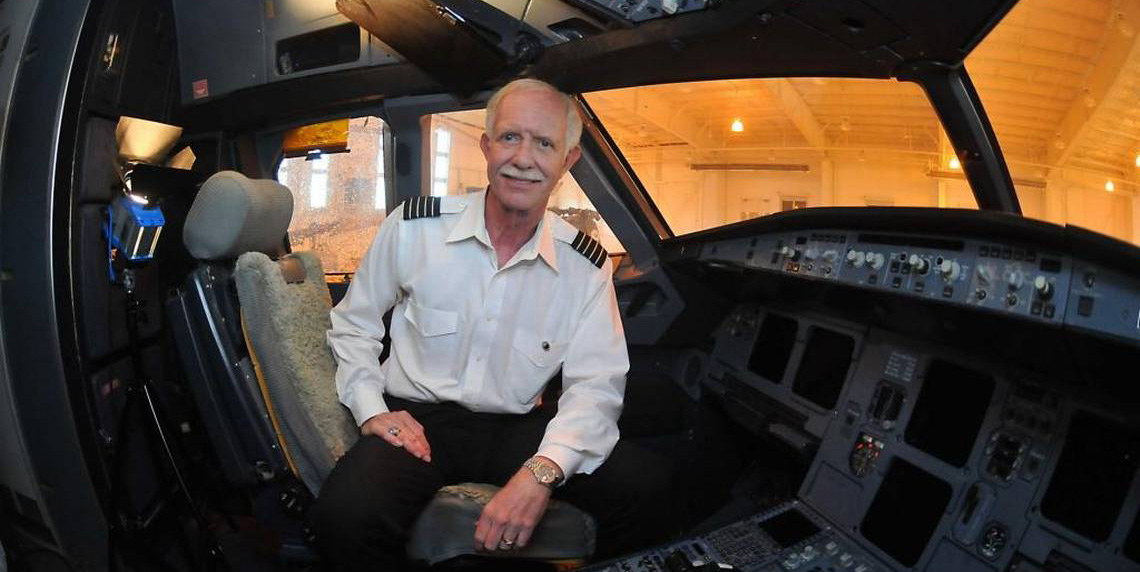

La película Sully (2016), dirigida por Clint Eastwood y protagonizada por Tom Hanks, cuenta la historia real del capitán Chesley “Sully” Sullenberger, quien aterrizó con éxito el vuelo US Airways 1549 en el río Hudson en enero de 2009 después de que ambos motores fallaran debido a la colisión con una bandada de aves. La hazaña, conocida como el “Milagro en el Hudson”, salvó a las 155 personas a bordo. La película no solo narra el aterrizaje de emergencia, sino también la investigación posterior en la que se cuestiona la decisión de Sully y si las simulaciones de inteligencia artificial (IA) podrían haber sugerido un resultado mejor o más seguro.

El aterrizaje de emergencia del vuelo 1549 es un ejemplo excelente para comparar la inteligencia humana y la inteligencia artificial en la resolución de problemas complejos y en condiciones extremas. Durante la investigación se realizaron simulaciones basadas en inteligencia artificial que replicaban el incidente para determinar si Sully realmente no tenía otra opción que aterrizar en el río. Los algoritmos mostraban alternativas, como regresar al aeropuerto o aterrizar en otro aeropuerto cercano, sugiriendo que esas maniobras podrían haber sido viables. Sin embargo, esta comparación expone diferencias clave entre la inteligencia humana y la IA.

Una de las principales diferencias entre Sully y la IA radica en la flexibilidad en la toma de decisiones bajo circunstancias inesperadas. Las simulaciones de IA son capaces de calcular rápidamente múltiples opciones basadas en datos precisos. Sin embargo, estas simulaciones carecen de la capacidad de interpretar variables no cuantificables que los humanos afrontan en tiempo real. En el caso de Sully, tuvo menos de 3 minutos para decidir qué hacer después de que fallaron ambos motores. En esta situación crítica, se basó en su vasta experiencia, intuición y la comprensión del entorno en tiempo real para decidir que un aterrizaje en el río Hudson era la única opción viable.

Una de las diferencias entre Sully y la IA radica en la flexibilidad en la toma de decisiones bajo circunstancias inesperadas

La IA, aunque muy eficiente en procesar grandes volúmenes de datos y ofrecer soluciones teóricamente óptimas, no puede “sentir” el estrés, la incertidumbre o las limitaciones del momento. Las simulaciones que sugirieron un aterrizaje en un aeropuerto cercano ignoraron el factor tiempo y el margen de error mínimo que Sully consideró al evaluar que no podía llegar de manera segura a esos aeropuertos. Esto ilustra cómo la inteligencia humana tiene una capacidad única para improvisar y adaptarse a lo inesperado, algo que la IA aún no puede replicar plenamente.

Uso del juicio moral y la experiencia humana

La experiencia y el juicio moral son elementos fundamentales que diferencian la toma de decisiones humanas de la basada en IA. En el caso de Sully, su experiencia como piloto comercial y militar influyó en su decisión de aterrizar en el río. Sabía que, a pesar de las condiciones difíciles, tenía una pequeña posibilidad de mantener el control del avión si intentaba un amerizaje. Este juicio no solo se basó en datos técnicos, sino en una comprensión profunda del comportamiento del avión, las condiciones meteorológicas y la posibilidad de minimizar el riesgo para los pasajeros.

La experiencia y el juicio moral son elementos que diferencian la toma de decisiones humanas de la basada en IA

Por otro lado, la IA carece de juicio moral. En las simulaciones presentadas durante la investigación, las alternativas mostraban una tasa de éxito estadística, pero no tenían en cuenta el valor de la vida humana en situaciones de incertidumbre. Las decisiones basadas en IA pueden ser eficientes en términos de optimización matemática, pero no consideran aspectos como la seguridad percibida, la confianza en las propias habilidades y el contexto emocional en el que se toman las decisiones. En el caso de Sully, su decisión fue más allá de un cálculo técnico: fue una respuesta humana, arraigada en la responsabilidad ética y la necesidad de proteger a las personas a bordo.

Evaluación de riesgos y consecuencias en situaciones ambiguas

La IA destaca en escenarios donde los datos son claros y las opciones pueden ser evaluadas objetivamente. Sin embargo, en situaciones ambiguas y de alto riesgo como la que enfrentó Sully, la inteligencia humana muestra una ventaja. Los datos iniciales que Sully tenía eran limitados: sabía que ambos motores habían fallado, que no tenía potencia y que estaba descendiendo rápidamente. A partir de esta información, tuvo que evaluar múltiples factores: la altitud, la velocidad, el tráfico aéreo, las condiciones geográficas y meteorológicas, y las probabilidades de supervivencia de los pasajeros.

Mientras que la IA puede evaluar escenarios alternativos con precisión milimétrica, no tiene la capacidad de incorporar incertidumbres no cuantificables. Por ejemplo, no puede evaluar la “sensación” que tiene un piloto sobre el comportamiento del avión en circunstancias críticas o los pequeños detalles que Sully, como piloto experimentado, pudo haber notado al evaluar la viabilidad de regresar a un aeropuerto. En lugar de seguir una ruta lógica basada en datos limitados, Sully optó por una decisión menos ortodoxa, pero que finalmente resultó ser la más segura dadas las circunstancias.

La IA puede evaluar escenarios alternativos con mucha precisión, pero no puede incorporar incertidumbres no cuantificables

Procesamiento emocional y estrés en tiempo real

Un componente fundamental de la inteligencia humana es la capacidad de gestionar el estrés y las emociones en situaciones de riesgo extremo. Sully, como humano, tuvo que hacer frente a la presión psicológica de salvar la vida de 155 personas bajo una inmensa presión y en un tiempo extremadamente limitado. La IA, por su parte, no experimenta estrés, lo que en algunos contextos puede parecer una ventaja. No obstante, en situaciones donde las emociones juegan un papel crucial, la capacidad de gestionar el estrés y tomar decisiones bajo presión es algo que la IA no puede emular.

El procesamiento emocional de Sully, combinado con su experiencia, le permitió mantener la calma y ejecutar un aterrizaje de emergencia en circunstancias casi imposibles. Esta capacidad humana para sobrellevar la presión extrema y seguir tomando decisiones correctas, incluso cuando el margen de error es mínimo, sigue siendo uno de los puntos en los que la IA está limitada.

Complementariedad entre la inteligencia humana y la IA

El caso de Sully ilustra las fortalezas únicas de la inteligencia humana en situaciones críticas y de alto riesgo, donde la experiencia, la intuición y el juicio ético juegan un papel crucial. Mientras que la IA puede ofrecer soluciones basadas en cálculos y datos precisos, carece de la capacidad para comprender el contexto emocional, gestionar el estrés y tomar decisiones intuitivas en condiciones impredecibles.

Sully ilustra las fortalezas únicas de la inteligencia humana en situaciones críticas, donde la intuición juega un papel crucial

Sin embargo, esto no significa que la IA sea inútil en estos contextos. Más bien, como lo menciona Daniel Innerarity en su reflexión sobre la inteligencia híbrida, la IA y la inteligencia humana deben verse como complementarias. En el caso del vuelo 1549, las simulaciones basadas en IA ayudaron a analizar posibles alternativas y verificar las decisiones tomadas por Sully, pero fue la inteligencia humana la que salvó vidas en una situación de extrema necesidad.

La enseñanza más importante de este análisis es que la IA, a pesar de sus increíbles capacidades técnicas, no puede reemplazar el juicio humano en situaciones de riesgo crítico. Los mejores resultados se obtienen cuando ambas inteligencias trabajan juntas, aprovechando la velocidad y precisión de la IA y combinándola con la flexibilidad, la ética y la adaptabilidad de la inteligencia humana.