por Manel Soengas

La Ley de Inteligencia Artificial (IA) de la Unión Europea (AI Act) establece un marco normativo para regular el uso de la IA en Europa. Esta legislación clasifica los sistemas de IA según su nivel de riesgo y establece restricciones específicas para proteger los derechos fundamentales, la seguridad y la privacidad. En el ámbito educativo, existen plataformas que utilizan IA para personalizar el aprendizaje, la corrección automatizada de exámenes y herramientas de gestión académica. El objetivo de este artículo es analizar cómo esta regulación afecta a la educación y qué usos de la IA estarán permitidos, restringidos o prohibidos.

Figura 1. Imagen generada con inteligencia artificial generativa.

La Ley de IA de la UE: Una visión general

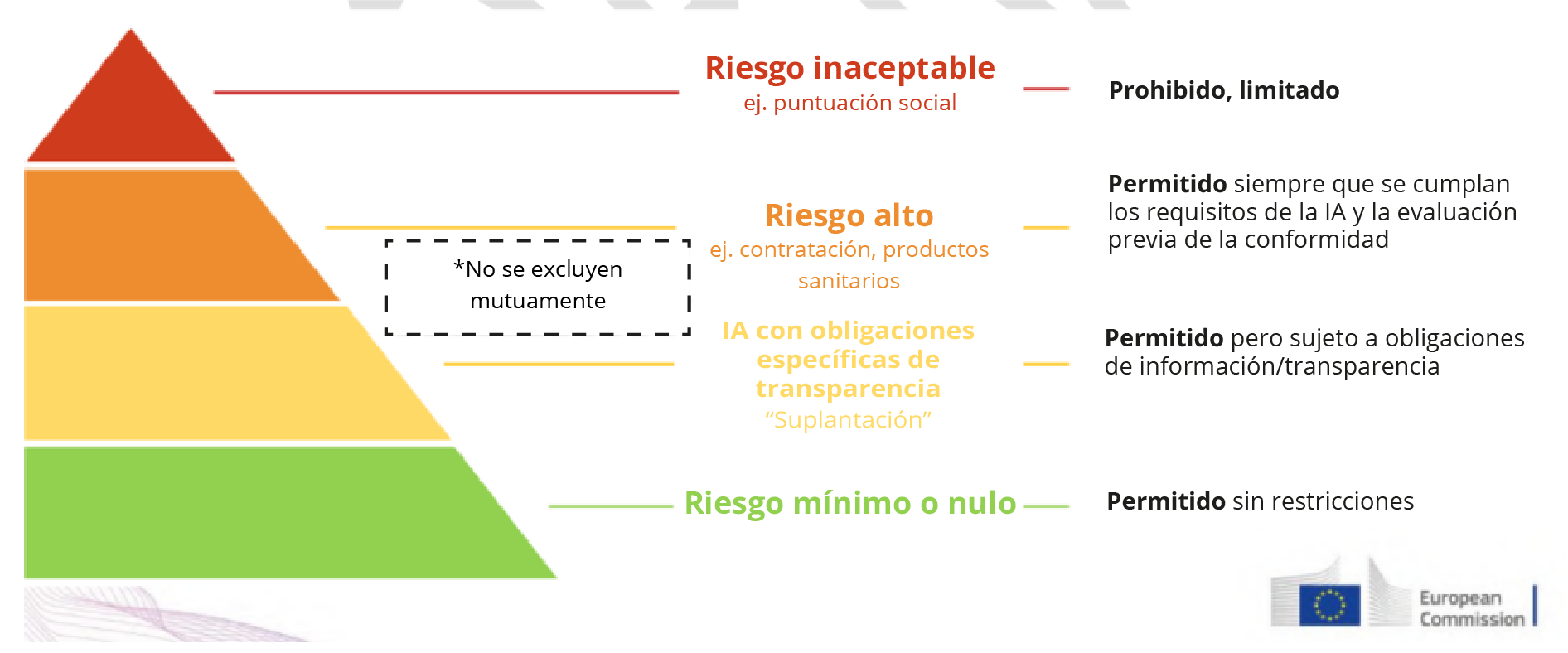

La Ley de IA europea clasifica las aplicaciones de IA en cuatro categorías de riesgo:

- Riesgo inaceptable: sistemas prohibidos por ser considerados una amenaza para los derechos fundamentales.

- Riesgo alto: aplicaciones que pueden afectar a la seguridad o a los derechos de las personas y que requerirán evaluaciones estrictas.

- Riesgo limitado: sistemas con requisitos de transparencia para garantizar un uso adecuado.

- Riesgo mínimo: aplicaciones que no suponen un peligro significativo y que pueden utilizarse libremente.

La Ley de IA clasifica las aplicaciones en cuatro niveles de riesgo: inaceptable, alto, limitado y mínimo

La IA en la educación: ¿Dónde se está aplicando?

Actualmente, la IA se está utilizando en diversos ámbitos de la educación, mediante plataformas y el uso de modelos de lenguaje:

- Aprendizaje personalizado: herramientas como Khan Academy con IA ajustan el contenido a las necesidades del estudiante.

- Evaluación automatizada: sistemas que corrigen exámenes tipo test e incluso redacciones.

- Tutores virtuales: asistentes de IA que ayudan a los estudiantes con dudas sobre diferentes materias.

- Plataformas de gestión académica: IA aplicada a la detección del abandono escolar o a la mejora en la planificación de recursos.

- Uso de inteligencia artificial generativa para la creación de actividades de aprendizaje mediante modelos de lenguaje (LLM).

A partir de este escenario se dan diferentes tipos de usos, según el perfil del ámbito:

- Administración: a pesar de no implementar sistemas de IA, ha elaborado orientaciones dirigidas a los centros educativos en materia de “Orientaciones y recomendaciones para el uso de la inteligencia artificial en los centros educativos” (AI Act). También organiza cursos de formación para el profesorado, así como la recopilación y difusión de buenas prácticas y recursos a través de una web corporativa.

- Centros educativos: Se combina el uso de plataformas y modelos de lenguaje para llevar a cabo tareas administrativas y de gestión, como la elaboración de horarios, la gestión de la asistencia o la creación de plantillas de documentos, entre otras.

- Docentes: Utilizan herramientas basadas en modelos de IA para preparar material didáctico, gestionar tareas administrativas o personalizar el aprendizaje, entre otros usos.

- Alumnado: Utilizan la IA generativa principalmente para generar contenido, apoyar el estudio o practicar idiomas, por citar algunos ejemplos.

Riesgos y regulación de la IA en educación según la Ley

El uso creciente de la inteligencia artificial en educación ofrece grandes oportunidades, pero también plantea retos que requieren una regulación clara. Sin un marco normativo adecuado, el uso de la IA en la evaluación, la personalización del aprendizaje o la gestión de datos puede generar sesgos, vulnerar la privacidad del alumnado y comprometer la equidad o la transparencia en los procesos educativos o de aprendizaje. Además, es esencial garantizar que estas tecnologías complementen la labor docente sin sustituir su rol pedagógico. Por ello, una regulación específica en el ámbito educativo es importante para asegurar un uso ético, responsable, seguro y equitativo de la IA en educación. La Ley de IA establece que algunas aplicaciones pueden considerarse de alto riesgo, mientras que otras serán aceptables bajo condiciones específicas.

Docentes y alumnos ya usan la IA para crear contenidos, pero es necesario tener en cuenta los límites legales y éticos de su uso

- Aplicaciones prohibidas (riesgo inaceptable): La comercialización, la puesta en marcha para esta finalidad específica o el uso de sistemas de IA para inferir emociones de una persona física en los ámbitos del lugar de trabajo y de las instituciones educativas, excepto cuando el uso del sistema de IA esté destinado a ser implantado o comercializado por razones médicas o de seguridad.

- Aplicaciones de alto riesgo (requieren evaluación previa): Educación y formación profesional.

- Sistemas de IA destinados a ser utilizados para determinar el acceso o la admisión o asignar a personas físicas a instituciones educativas y de formación profesional de todos los niveles.

- Sistemas de IA destinados a utilizarse para evaluar los resultados del aprendizaje, incluso cuando dichos resultados se usen para orientar el proceso de aprendizaje de las personas en centros educativos y de formación profesional de todos los niveles.

- Sistemas de IA destinados a ser usados para evaluar el nivel educativo adecuado que una persona recibirá o al que podrá acceder, en el contexto de instituciones educativas y de formación profesional de todos los niveles.

- Sistemas de IA destinados a usarse para controlar y detectar comportamientos prohibidos de los estudiantes durante los exámenes en el contexto de instituciones educativas y de formación profesional de todos los niveles o en su seno.

- Aplicaciones de riesgo mínimo: La normativa sobre IA no establece requisitos específicos para los sistemas considerados de riesgo mínimo o nulo. La mayoría de las aplicaciones de IA actualmente en uso en la UE pertenecen a esta categoría, como los videojuegos con funcionalidades de inteligencia artificial o los filtros automáticos para detectar correo no deseado.

Estos sistemas están sujetos a estrictas obligaciones para garantizar su seguridad y fiabilidad. Algunos de los requisitos que deben cumplir son los siguientes: evaluación de la conformidad, gestión de riesgos, calidad de los datos, documentación técnica, transparencia e información al usuario, supervisión humana y ciberseguridad.

Figura 2. Reglamento Europeo de IA.

La AI Act se aprobó en 2024 y seguirá un proceso de implementación progresiva en los próximos años. Según el calendario previsto, en 2027 se aplicará a todos los actores implicados.

Implicaciones para docentes e instituciones educativas

El marco legal establecido por el Parlamento Europeo obliga a los gobiernos a implementar la ley de manera gradual. Sin embargo, hasta que su aplicación sea completa, es necesario tener en cuenta algunos escenarios:

- El uso de un LLM (modelo de lenguaje) está sujeto a limitaciones de edad, lo que implica directamente al alumnado. En algunos casos puede ser necesaria la autorización de los padres o tutores legales.

- En cuanto a aplicaciones o plataformas basadas en el uso de LLM, como ChatGPT, se recomienda no utilizarlas como herramientas de evaluación. No existe ninguna evaluación previa que acredite, valide y autorice este uso. Esto no significa que los LLM no puedan tener ningún uso educativo; pueden emplearse como herramientas de apoyo.

- En el caso de herramientas o recursos basados en IA, es necesario verificar dónde se almacenan los datos, si se ceden a terceros, quién tiene acceso a ellos y si los datos o conversaciones se utilizan para entrenar y mejorar el modelo.

Los centros educativos deberán revisar la seguridad de los datos antes de introducir herramientas basadas en IA generativa

Aunque el Reglamento General de Protección de Datos (RGPD) ya establece normas estrictas, la Ley de Inteligencia Artificial (AI Act) aún no se aplica completamente. Este vacío legal obliga a estar alerta, vigilar y comprobar que las herramientas o recursos basados en IA cumplen con los estándares exigidos por el RGPD y se adaptan a las futuras regulaciones de la AI Act.

Para los usuarios y centros educativos, estos aspectos a menudo pasan desapercibidos debido a su complejidad legal, lo que puede suponer riesgos en la protección de datos y la privacidad. A partir de este escenario, se recomienda, antes de utilizar un modelo de IA generativa (LLM) o contratar un servicio basado en IA, llevar a cabo las siguientes acciones:

- Revisar las políticas de privacidad para comprobar si los datos se utilizan para entrenar el modelo o si se comparten con terceros.

- Priorizar herramientas de IA que cumplan con el RGPD y que ofrezcan garantías sobre el tratamiento de los datos.

- Consultar si el proveedor está sujeto a las regulaciones de la UE y si adopta medidas para anticiparse a la AI Act.

- Evitar servicios que no sean transparentes sobre el uso y almacenamiento de datos, especialmente en entornos educativos.

- Si se trata de un servicio destinado a menores de edad, asegurarse de que cumple con la normativa de protección de datos para menores y que no requiere información personal innecesaria.

Conclusiones y perspectivas de futuro

La Ley de IA europea marcará un antes y un después en el uso de la IA en educación. Aunque algunas aplicaciones estarán restringidas para proteger los derechos de los estudiantes, muchas otras podrán transformar positivamente el aprendizaje. Los docentes e instituciones tendrán que adaptarse a este nuevo marco legal para garantizar un uso ético y responsable de la IA. La formación en IA y la regulación serán claves para aprovechar su potencial sin poner en riesgo los principios fundamentales de la educación.

Manel Soengas es docente de tecnología, ingeniero industrial y máster en IA. Actualmente, trabaja como gestor tecnológico en el área TIC del Departamento de Educación, combinándolo con tareas de formación en cultura digital, divulgación, comunicación y asesoramiento en relación con la inteligencia artificial.